Les enseignants du premier degré face à l'intelligence artificielle : entre attentes et craintes en tension

Manuel Schneewele

Universidad de Orleans (Francia)

manuel.schneewele@univ-orleans.fr

https://orcid.org/0000-0002-2313-3274

Karine Alexis Girault

Universidad de Orleans (Francia)

Centro Nacional de la Función Pública Territorial (Francia)

karine.alexisgirault@cnfpt.fr

https://orcid.org/0009-0007-2696-1204

Esta obra está bajo una licencia internacional Creative Commons BY-NC-SA 4.0

DOI:https://doi.org/10.5281/zenodo.17537584

Sección: General

Recibido: 29 de julio de 2025

Aceptado: 22 de septiembre de 2025

Publicación: 07 de noviembre 2025

Résumé

Cet article examine les facteurs facilitant l’adoption de l’intelligence artificielle (IA) des enseignants du primaire français dans le cadre du programme national P2IA. Le cadre théorique s’appuie sur les théories sur les représentations sociales afin d’analyser les croyances collectives autour de l’IA. La méthodologie adoptée est de nature mixte, reposant principalement sur la technique des associations de mots. Elle est mise en œuvre via un questionnaire rempli par 75 enseignants afin d’identifier les éléments moteurs à l’utilisation des IA en classe. Les résultats montrent que l’IA est symboliquement associée à la figure du robot et perçue comme une promesse de progrès pédagogique, notamment pour la différenciation et le suivi individualisé. Cependant, des craintes éthiques et une méconnaissance de son fonctionnement technique émergent également, traduisant une ambivalence dans les représentations collectives. L’étude souligne par ailleurs le rôle central des réseaux sociaux professionnels et de la collaboration entre collègues dans la diffusion et l’appropriation de l’IA. En revanche, le manque de formation adaptée, de temps et de ressources matérielles constitue un frein important. Ces résultats soulignent l’importance de tenir compte de ces éléments dans les formations des enseignants afin de mieux les accompagner dans l’intégration pédagogique de l’IA et de surmonter les obstacles identifiés. Enfin, l’article propose de poursuivre la recherche au moyen d’études longitudinales qui permettront de suivre l’évolution des représentations relatives aux bénéfices pédagogiques perçus, dans un contexte éducatif en constante mutation.

Mots clés: Représentations sociales, adoption, technologies éducatives, développement professionnel, obstacles.

Primary school teachers facing artificial intelligence: Between expectations and concerns in tension

Abstract

This article examines the factors facilitating the adoption of artificial intelligence (AI) by French primary school teachers within the framework of the national P2IA program. The theoretical framework is based on social representation theories to analyze collective beliefs surrounding AI. The methodology is mixed, primarily relying on the word association technique, implemented through a questionnaire completed by 75 teachers to identify the driving factors behind AI use in the classroom. The results show that AI is symbolically associated with the figure of the robot and is perceived as a promise of pedagogical progress, particularly for differentiation and individualized student monitoring. However, ethical concerns and a lack of technical understanding also emerge, reflecting an ambivalence in collective representations. The study further highlights the central role of professional social networks and collaboration among colleagues in the dissemination and appropriation of AI. Conversely, the lack of adequate training, time, and material resources constitutes a significant barrier. These findings emphasize the importance of considering these elements in teacher training to better support educators in the pedagogical integration of AI and to overcome identified obstacles. Finally, the article suggests continuing research through longitudinal studies to track the evolution of representations related to perceived pedagogical benefits, in a constantly changing educational context.

Keywords:Social representations, adoption, educational technologies, professional development, barriers.

Introduction

L'intelligence artificielle (IA), dont le développement et les usages tendent à se généraliser dans de nombreux secteurs, n’épargne pas celui de l’éducation. En France, le ministère de l’Éducation Nationale (MEN) s'est engagé très tôt dans cette dynamique de modernisation de l’éducation avec le rapport Villani (2018), qui a marqué un tournant dans l'intégration de l'IA au service de l'enseignement, en pointant la nécessité de son développement et de son usage dans l’éducation et la formation.

En résonance avec les recommandations de l'UNESCO (2019), l'IA occupe désormais une place centrale dans les stratégies éducatives françaises. Un engagement qui se traduit par la création du Partenariat d'Innovation et d'Intelligence Artificielle (P2IA), qui vise à faciliter le travail des enseignants et à adapter les pratiques pédagogiques aux besoins des élèves grâce à des solutions numériques basées sur l'IA.

Dans le but de préparer les générations futures, le ministère français adopte une approche résumée par la formule « enseigner le numérique et par le numérique » (MEN, 2021). Cette dynamique est renforcée par l’introduction du référentiel européen de compétences numériques (DigComp) et par la plateforme PIX, dédiée à l’évaluation des compétences numériques. Une double ambition est ainsi poursuivie : faire de l’intelligence artificielle à la fois un objet d’apprentissage et un levier pédagogique (MEN, 2021).

Sur le terrain, impulsé par le P2IA, les enseignants et plus particulièrement ceux du premier degré et de cycle 2 (du CP au CE2), sur lesquels nous mettrons la focale dans cette recherche, se voient donc invités par les instances académiques à adopter des solutions pour lesquelles ils investissent dans des licences, c’est le cas de Lalilo, Kaligo, Navi pour le français, ou Adaptiv'Math, Mathia et Smart Enseigno pour les mathématiques. Des outils promettent aux enseignants de fournir des activités personnalisées et un suivi adaptatif capables de répondre aux besoins spécifiques de chaque élève.

Afin de comprendre les dynamiques d’intégration et de résistance à l’IA dans les pratiques quotidiennes d’enseignement en primaire, cette recherche s’appuie sur l’analyse des représentations que partagent les enseignants à l’égard de ces outils, dans l’objectif d’identifier les leviers et les freins à leur adoption, tout en explorant les opportunités de plus-value qu’ils associent à ces technologies. En prenant pour population les enseignants de cycle 2, une population qui a pu bénéficier du P2IA et dont les retombées ont été peu documentées par la littérature, cette étude s’interroge par conséquent sur les schèmes cognitifs et symboliques qui sous-tendent leurs attitudes, leurs pratiques et leurs besoins en formation à l’égard de solutions basées sur l’IA.

Définitions et applications de l’Intelligence Artificielle (IA)

L'IA, dont le terme a été introduit dès les années 50 par McCarthy et al. (1956), se définit comme la discipline qui crée des programmes capables d'accomplir des tâches généralement réalisées par des humains mais nécessitant des processus mentaux complexes. Deux approches principales existent (Georges, 2019 et Sabouret et De Assis, 2019) :

- Les « systèmes experts », qui cherchent à reproduire le raisonnement humain en appliquant un ensemble de règles sur des données en vue de fournir des recommandations ou une aide telle un « expert » éclairé sur un domaine de compétence. Cela renvoie notamment aux « tuteurs intelligents » lesquels s’appuient sur des modèles de connaissances à enseigner, de tâches à réaliser par les élèves, d’erreurs et de feedback considérés comme pertinents.

- L’apprentissage automatique par la machine ou « machine learning », qui repose sur l’abandon des règles explicites au profit de modèles statistiques et d’algorithmes, permettant à la machine de générer ses propres règles à partir d’un grand nombre de données. Cette approche s’appuie sur la construction de réseaux de neurones artificiels, dont l’architecture se construit sur plusieurs couches interconnectées. Cela a conduit à l’émergence de l’apprentissage dit profond ou « deep learning » (Le Cun et al., 2015), fortement accéléré par l’augmentation des puissances de calculs et l’accès au « big data » c’est-à-dire à de grandes quantités de données. On retrouve ce système pour la reconnaissance vocale, l’analyse d’images et la traduction automatique.

Toutefois, précisons, comme le souligne la littérature (Russell et Norvig, 2016 ; Pearl, 2020), qu’une IA ne dispose pas de véritables capacités de raisonnement, elle se limite à l’exécution d’algorithmes ou de règles programmés par des humains. De même, l’IA dans le système éducatif n’est pas une nouveauté. Amadieu et Tricot (2020) rappellent que, dès les années 1970, les chercheurs se sont interrogés sur la possibilité de concevoir des machines capables de reproduire l’acte d’enseigner et d’épauler les enseignants dans leurs activités d’enseignement.

Vers la compréhension des usages au travers de l’analyse des représentations

Pour comprendre et expliquer comment se forme l’adoption des IA par les enseignants du premier degré, il paraît essentiel d’expliciter dans un premier temps leurs attentes, leurs craintes mais surtout leur vision de l’IA. En adoptant le postulat que les individus adaptent leurs comportements en fonction de l’idée qu’ils se font de leur environnement (Durkheim, 1894). Le sens attribué à une technologie se construit alors à travers des interactions sociales, un imaginaire collectif dans lequel des symboles émergent, conférant à l’objet une identité sociale et narrative (Ricoeur, 1990). Se forme ainsi un savoir socialement élaboré et partagé (Jodelet, 1991) qui se veut également un savoir naïf du fait de son manque d’objectivité et que la littérature qualifie de « représentation sociale » telle que le décrit Moscovici (1986), laquelle va guider les comportements d’usage.

Abric (2001) décrit la représentation sociale comme un ensemble organisé et structuré d’éléments organisés autour d’un noyau central qui constitue le cœur de la représentation, et d’éléments périphériques qui gravitent autour de ce noyau et qui jouent le rôle de rempart, ou zone tampon, dont l’objectif est de permettre d’intégrer des modifications de l’environnement ou de faire face à la nouveauté. Une conception que nous adopterons dans le cadre de ce travail de recherche par la mise en évidence des éléments centraux et secondaires caractéristiques de la représentation que partagent les enseignants du premier degré à l’égard de l’IA.

Cependant, le processus de construction de sens d’une représentation collective ne se limite pas à une simple perception passive. Il s’appuie également sur un ensemble de facteurs jugés prépondérants, tels que la perception d’utilité et la facilité d’utilisation pédagogique, qui jouent un rôle central dans l’acceptation d’une nouvelle technologie par les enseignants (Amadieu et Tricot, 2020 ; Venkatesh et al., 2003 ; Renaud 2020 ; Kahnbach et al., 2024). Si de nombreuses études ou rapports reconnaissent l’intérêt de l’IA pour la personnalisation de l’apprentissage, encourager l’engagement, favoriser la continuité pédagogique, faciliter l’évaluation ou acculturer les élèves au numérique (Karsenti 2018 ; Oficina de Ciencia y Tecnología del Congreso de los Diputados, 2024 ; Sergent, 2021), il apparaît rare d’en trouver qui se focalisent sur la représentation des enseignants français et plus particulièrement du primaire à l’égard de cette technologie. Toutefois, au regard des conclusions de travaux étrangers, nous pouvons supposer, que les enseignants devraient avoir une attitude plutôt positive à l’égard de l’IA (Polak et al., 2022), lui reconnaissant une certaine valeur ajoutée basée sur la possibilité d’améliorer leur développement professionnel (Alvarez-Herrero, 2024), mais aussi, un sentiment d’obligation morale et professionnelle à se familiariser avec les IA pour alléger leur charge de travail (Majkić et Vranješ, 2024). La venue des IA dans l’enseignement se ferait de plus dans un contexte où le niveau de connaissances reste limité car les enseignants signalent régulièrement un manque de préparation, des difficultés matérielles ou un manque de formation dans le domaine (Besneville et al., 2019 ; Romero et al., 2023) engendrant ainsi des frustrations professionnelles en décalage avec les attentes de la politique ministérielle.

Enfin, au regard des travaux de Bewersdorff et al. (2023) qui réalisent une revue de la littérature autour des mythes liés à l’IA mais sur une population d’apprenants, il est constaté une tendance à attribuer à ces outils des caractéristiques ou des attributs humains, d’où une représentation sous la forme de robots avec des bras et des jambes. De même une perception de l’IA plutôt binaire : l’une pessimiste basée sur la peur d’un excès de confiance envers ces outils dépourvus d’émotions et d’affects qui tendent à remplacer des personnes, l’autre optimiste tournée vers l’espoir de faciliter la vie des gens notamment dans le domaine de la santé et des apprentissages.

Par conséquent, nous faisons l’hypothèse que les enseignants devraient avoir une attitude plutôt positive quant à l’adoption de l’IA en raison du potentiel d’opportunités offert par cette technologie dans le cadre de leurs activités d’enseignement et d’accompagnement des élèves. Néanmoins, nous pouvons aussi supposer qu’il est fort probable que leur vision de l’IA reste somme toute assez vague, en partie basée sur les mythes évoqués par Bewersdoff et al. (2023) du fait d’un manque de connaissances ou de formations dans le domaine, ce qui pourrait être l’un des freins à l’usage.

Méthodologie

Pour comprendre comment les enseignants du premier degré en cycle 2 (CP, CE1, CE2) perçoivent l’arrivée de l’IA dans leur profession, nous avons eu recours à un questionnaire en ligne réalisé à l’aide de Sphinx Déclic 2 dont la durée de passation moyenne était d’environ 18 minutes. Sa diffusion s’est faite de mai à juin 2022 via les réseaux sociaux utilisés par les membres de l’académie d’Orléans-Tours : d’une part, via Facebook et trois groupes d’échanges privés, d’autre part, via une liste de diffusion de circonscription relayée par l’intermédiaire d’un conseiller pédagogique.

75 réponses ont été recueillies, révélant une population majoritairement féminine (97%), une proportion qui n’est pas si surprenante étant donné que les femmes représentent 88 % de la profession en région Centre-Val de Loire, selon l’INSEE (2023). Parmi les répondants, 88 % (n=66) ont une expérience d’enseignement supérieure à 10 ans. La répartition des âges se structure la manière suivante : 47% ont entre 46 et 55 ans, 44% entre 36 et 45 ans, 5% entre 26 et 35 ans et 4% plus de 56 ans.

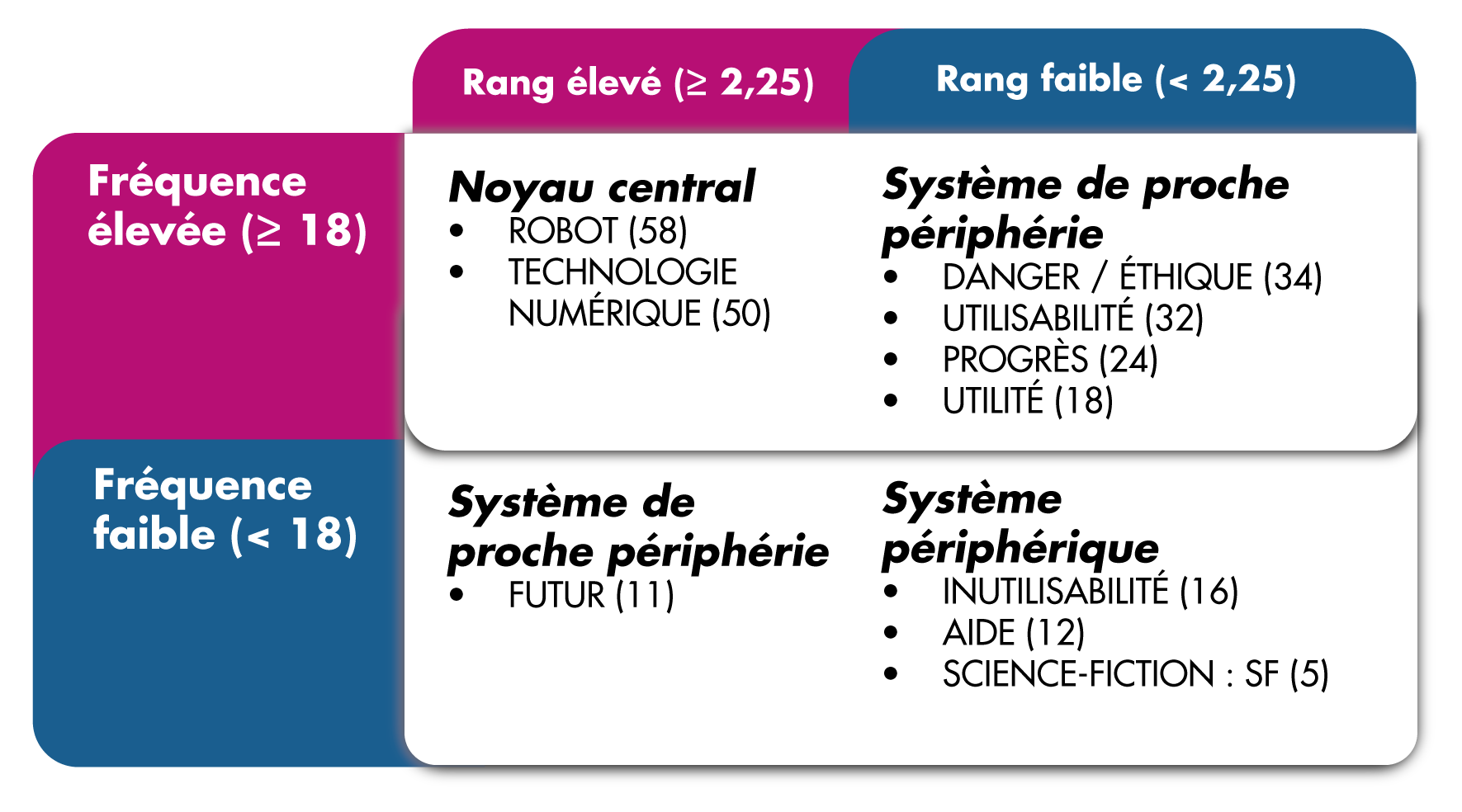

Afin de faire apparaître la structure de la représentation au sens d’Abric (2001), c’est-à-dire la constitution du noyau central et de ses éléments périphériques, la méthode des associations libres de mots développée par Vergès (1992) est employée. Elle consiste à inviter les participants à indiquer 3 à 6 mots ou expressions qui leur viennent spontanément à l'esprit lorsqu’on leur parle d’«intelligence artificielle » et à faire apparaître ces éléments dans l’ordre de leurs pensées. Le traitement des données se base alors sur deux mesures : la fréquence d’apparition des mots et le rang ordonné d’apparition. Les résultats sont présentés dans un tableau qui croise les valeurs médianes de ces deux mesures. Le noyau central de la représentation est alors composé des éléments les plus fréquemment mentionnés et évoqués en premier, tandis que les éléments périphériques sont ceux qui apparaissent moins fréquemment et à des rangs de classement plus élevés. Afin d’améliorer la lisibilité, des regroupements ont été effectués en raison de la similarité de certains mots au niveau des éléments périphériques.

Outre des indications sur le profil, le questionnaire comportait également un ensemble de questions exploratoires. Notamment, s’ils seraient prêts à utiliser une application basée sur l’IA dans leur classe. Quelles source(s) d’information avaient le plus contribuées à façonner leur représentation de l’IA. S’ils utilisent déjà des solutions du P2IA (Lalilo, Kaligo, Mathia, Adaptiv’Math, SmartEnseigno, Navi) avec leurs élèves, et parmi ses utilisateurs, quelle est la plus-value qu’ils ont perçue? Enfin, des questions ouvertes analysés par regroupement thématiques avaient pour objectif de préciser les moteurs et freins perçus par les enseignants quant à l’adoption de solutions basées sur les IA dans l’enseignement primaire.

Il est néanmoins à souligner que la méthodologie employée est sujette à certaines limites. Le recours aux canaux de diffusion utilisés par l’académie d’Orléans-Tours cantonne les réponses obtenues à ceux de la région Centre-Val de Loire. Une région qui se situe au sud de Paris et rassemble six départements. Cette restriction géographique est susceptible de ne pas rendre compte de toute la diversité des éléments qui composent la représentation de l’IA au niveau national. De plus, les participants sont avant tout des enseignants qui ont accepté de prendre part à ce travail de recherche. Par conséquent, nous pouvons supposer qu’ils ont une certaine appétence pour la thématique du numérique. Enfin, la diffusion du questionnaire via les réseaux sociaux et les listes de diffusion peut introduire un biais d’auto-sélection, privilégiant le profil d’enseignants davantage enclins à l’usage d’outils numériques et probablement mieux informés sur la thématique et les usages de l’IA.

Résultats

Représentation sociale et éléments d’influence

Les premiers résultats font apparaître que 74% (n=56) des répondants se disent prêts à utiliser des solutions basées sur l’IA dans leur classe (figure 1), ce qui peut se traduire par une représentation plutôt positive à l’égard de ces outils.

Parmi les éléments qui auraient le plus contribué à la construction de la représentation qu’ils se font de l’IA (figure 1), les enseignants déclarent se baser majoritairement sur des reportages ou émissions grand public (60%, n=45) tout comme les représentations issues de la science-fiction (60%).

Figure 1:Éléments identifiés par les enseignants comme ayant le plus contribué à façonner leur représentation de l’IA

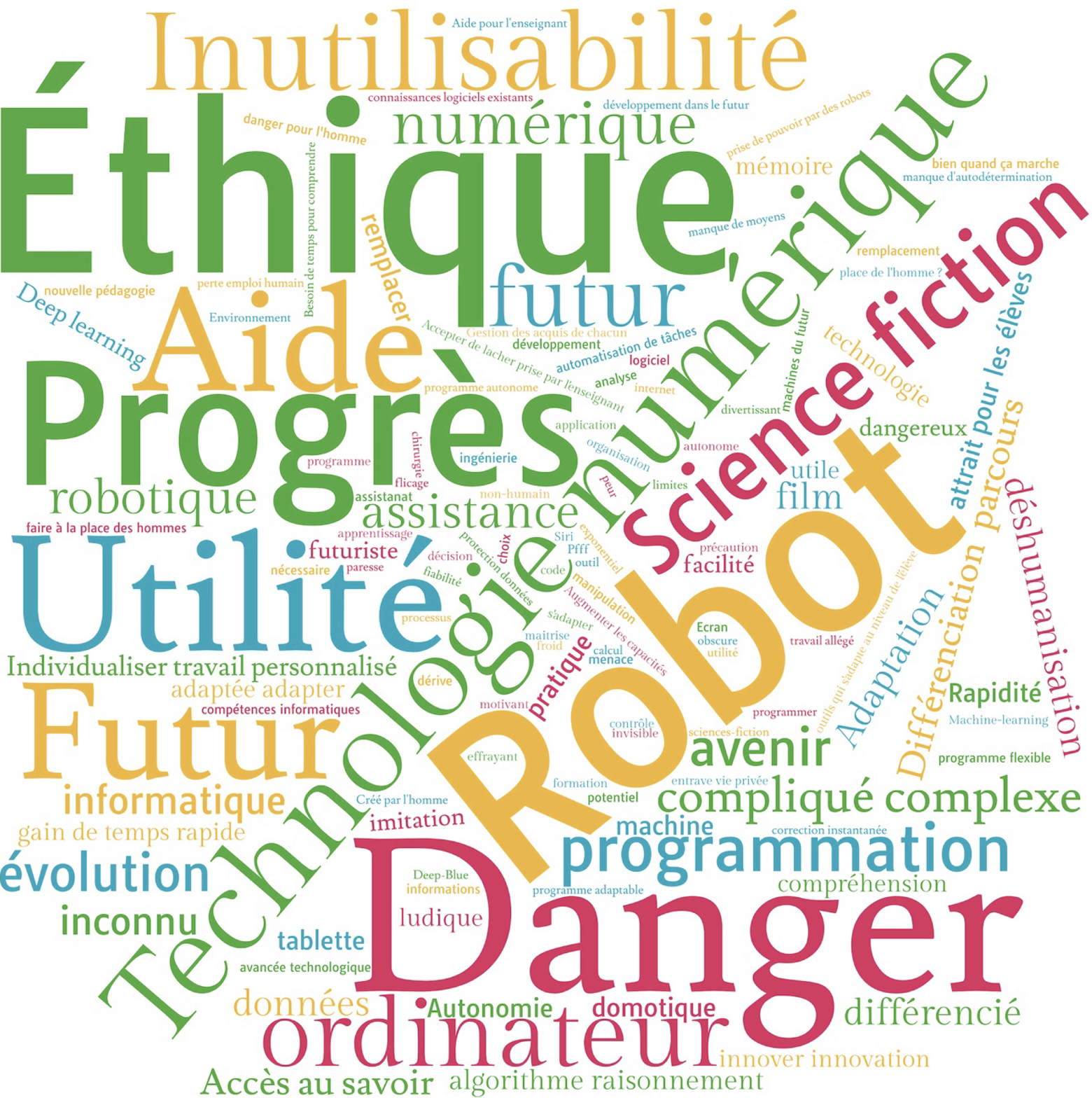

Afin de déterminer la représentation sociale de l’IA que partagent les enseignants du premier degré, nous observons dans un premier temps un ensemble de mots qui apparaissent le plus fréquemment et qui peuvent s’illustrer par un nuage de mots (figure 2). Il peut ainsi être observé la présence majeure des termes : robot, éthique, technologie numérique, danger, progrès, utilité et futur.

Figure 2:Nuage de mots évoqués par les enseignants comme représentatifs de l'IA

Néanmoins, pour faire apparaître les éléments saillants de la représentation de l’IA au sens d’Abric (1994), un tableau est constitué, lequel distingue le noyau représentationnel avec un rang d’apparition médian autour de 2 et une fréquence médiane d’apparition des mots de 18 (Tableau 1). Un ensemble de mots sont ainsi relevés, dont l’interprétation sera, lorsque cela est possible, mise en analogie avec le discours obtenu aux questions ouvertes ainsi que les expressions ou expressions minoritaires appartenant à la même thématique lexicale.

Tableau 1: Structure de la représevntation de l'IA chez les enseignants du 1er degré

La lecture des résultats permet de constater que le noyau central, reflet de la pensée symbolique la plus marquée, s’articule autour de la référence au ROBOT et à la TECHNOLOGIE NUMERIQUE. Cette centralité symbolique suggère notamment une analogie implicite avec la figure d’un «humanoïde» faisant preuve d’autonomie et de capacité de raisonnement.

Autour de ce noyau gravitent des éléments de proche périphérie qui précisent et modulent les comportements à son égard. Parmi eux, figurent les termes de :

- DANGER/ÉTHIQUE: cette catégorie semble refléter les «craintes» et interrogations «éthique» liées à l'IA, avec des termes souvent connotés négativement, évoquant la «peur du remplacement» des enseignants, la «perte de contrôle» sur l'apprentissage et les «dérives possibles».

- UTILISABILITÉ : traduit les attentes des enseignants quant à l' «ergonomie » et une utilisation « facile » de l'IA dans leurs pratiques pédagogiques.

- UTILITÉ : exprime les attentes des enseignants quant aux « bénéfices » pédagogiques de l'IA, notamment en matière d'«individualisation des parcours» d'apprentissage, d'amélioration des « résultats scolaires », du « suivi » des élèves et de « réduction de la charge de travail ».

- PROGRÈS: confère une dimension positive à l'IA, souvent perçue comme un vecteur d’«innovation» pédagogique.

- FUTUR : complète l’idée de progrès mais pourrait également marquer un éloignement à l’égard des pratiques actuelles.

Les éléments les plus éloignés du noyau s’articulent quant à eux autour des problématiques d’INUTILISABILITÉ soulignant très certainement un manque de moyens matériels ou d’accessibilité, d’AIDE notamment par « un manque de formations » et enfin d’une technologie qui relève de la SCIENCE-FICTION probablement en raison de la difficulté à comprendre comment ces technologies fonctionnent.

Perceptions des éléments moteurs et freins à l’usage des IA par les enseignants

Les résultats aux questions ouvertes sur leurs perceptions des moteurs de l’usage font apparaître que pour la majorité des enseignants, « la formation » et le « partage d'expériences entre collègues » sont essentiels pour adopter l'IA en classe. Ils souhaitent comprendre le fonctionnement de ces outils à travers des « cas concrets » et bénéficier « des retours d'utilisateurs expérimentés ». L'intérêt pédagogique pour l'élève et l'enseignant est également souligné, l'IA est « un moyen de personnaliser » l'apprentissage, de « motiver » les élèves et de « suivre leur progression ». Dans une moindre mesure l'« ergonomie » est également évoquée : les enseignants recherchent des « solutions simples », « intuitives » et « efficaces », qui puissent leur faire « gagner du temps ». Toutefois, ils estiment avoir « besoin de temps » et de « matériel adapté ».

Une focale sur les personnes 37 enseignants (49%) qui utilisent dans leurs activités d’enseignement des solutions du P2IA permet de constater que pour eux, la plus-value des IA se situe principalement dans la prise en charge de la différenciation pédagogique (86%, n=32), la visualisation des résultats des élèves (84%, n=31), et le fait qu’elles permettent d’adapter la prise en charge individuelle de leur progression (48%, n=18). Ils soulignent de plus l’importance du partage de pratiques sur les réseaux sociaux (94%, n=35) ainsi que le conseil des collègues (72%, n=27) dans la découverte et la décision d’utiliser ces outils.

À l’image des moteurs à l’adoption des IA on retrouve parmi les freins exposés par l’ensemble des enseignants, le « manque de formation », « de retours d'expériences » concrètes et dans moindre mesure l’«absence de matériels» et le « manque de temps » pour s'adapter à ces nouveaux outils. ». Mais on observe surtout des « craintes » qui concernent le « remplacement » de l’humain par la machine, la « perte du pouvoir d’agir » de l’enseignant ou encore un « temps d’écran accru ». Précisons que seuls 9% (n=7) des répondants n'expriment, dans l’ensemble du questionnaire, aucune réticence face à ces outils, et que 5% (n=4) remettent en doute l’« efficacité » ou l’existence d’« une plus-value pédagogique » des IA.

Discussion

Le noyau de la représentation de l’IA, qui incarne une conception stable et consensuelle selon Abric (2001), est construit autour de l’analogie au « robot » et à la « technologie numérique ». Une symbolique qui suggère une conception anthropomorphe de l'IA, qui rejoint les conclusions de Bewersdoff et al. (2023) sur le fait de prêter aux IA des attributs de type humain. Une observation qui s’inscrit dans la continuité d’une tendance plus générale à attribuer aux innovations numériques des qualités qui relève davantage du registre du « mythe » par rapport aux réalités effectives et observables sur le terrain comme le souligne les travaux de Amadieu et Tricot (2020).

Les éléments de proche périphérie du noyau, montrent quant à eux un accueil controversé de l’intégration des IA dans les pratiques d’enseignement. Le fait qu’ils perçoivent du « danger » et des problèmes « éthiques » à l’égard de ces outils montrent une prise de distance, laquelle est renforcée par le terme de « futur ». Un constat qui tend à renforcer les conclusions de Bewersdorff et al. (2023) mettant en évidence à la fois la peur d’un remplacement par les machines et l’excès de confiance qui peut être accordé à ces outils. Une perte du pouvoir d’agir pour l’enseignant au sens de Maury et Hedjerassi (2020), qui pose des problèmes « éthiques » que soulèvent plusieurs travaux récents (Collin et Marceau 2022, Zeyringer, 2024), renforcé par l’opacité des algorithmes (Alexandre, 2019) sur le processus de contrôle des apprentissages.

Les références à l'« utilité » et à l’« utilisabilité » montrent l’importance de ces critères dans le choix des outils en éducation comme le souligne également les travaux de Renaud (2020) et Kahnbach et al. (2024). Nos résultats montrent l'IA comme une technologie susceptible d’apporter des bénéfices notables. Un gain de temps dans la charge de travail qui s’appuierait sur une amélioration de l’ergonomie des outils numérique mais également des possibilités d'individualisation des parcours et de suivi des élèves accrus. Des observations qui vont dans le sens des conclusions de Majkić et Vranješ (2024), Karsenti (2018) et Álvarez-Herrero (2024) qui soulignent la présence d’une obligation professionnelle à intégrer les IA dans leurs pratiques professionnelles pour rester efficace et assurer leur développement professionnel. Un sentiment qui semble véhiculé par les médias et le discours institutionnel (Collard et al., 2020), ce qui explique probablement que dans l’enquête, 74% des répondants se déclarent prêt à utiliser les IA alors qu’ils sont au moment de l’enquête moins de 49% à réellement employer ces outils sur le terrain. L’adoption de l’IA serait bien perçue comme vectrice d’un « progrès », en accord avec les observations de Polak et al. (2022). Elle bénéficie d’une perception positive de l’IA construite sur les bénéfices qu’elle est supposée apporter aux pratiques pédagogiques existantes, tout en étant ralentie par le faible niveau de compétences numériques des enseignants dans ce domaine. Ce faible niveau de connaissance se reflète dans nos résultats, les enseignants dénoncent un « manque de formations » et « de retours d'expériences », des freins fréquemment identifiés dans les travaux sur le numérique (Besneville et al., 2019 ; Romero et al., 2023).

Cette prise de distance à l’égard de l’adoption de l’IA se manifeste également par la présence du terme « futur » et le besoin d « aide » qui se retrouve dans les éléments les plus éloigné du noyau. Une technologie qui resterait somme toute assez floue pour les enseignants du premier degré. Comme nous l’avons vu, ils semblent l’aborder avec beaucoup de prudence, l’usage des IA resterait ainsi pour partie floue puisqu’ils dénoncent un manque de préparation également souligné par Romero et al. (2023), accentuée par le fait qu’ils reconnaissent avoir fondé leur représentation en grande partie sur les reportages et émissions grand public ainsi que sur un imaginaire issu du monde de la science-fiction.

Enfin, parmi les freins évoqués, on retrouve obstacles classiques d’un manque de formations, de disponibilités matérielles mais aussi de manque de temps, régulièrement mis en évidence dans la littérature (Besneville et al. 2019 ; Romero et al. 2023 ; Majkić et Vranješ, 2024). Toutefois, un autre facteur semble jouer un rôle déterminant, c’est le poids des réseaux sociaux et les recommandations entre pairs. Cette dynamique sociale apparaît comme un levier important dans la découverte et l’adoption effective des outils à base d’IA par les enseignants. De plus, une focale sur la population déjà utilisatrice témoigne d’une forte reconnaissance de ces outils pour améliorer la prise en charge de la différenciation pédagogique, offrir une meilleure visibilité des résultats des élèves et optimiser la prise en charge des progressions individuelles, dans une perspective de continuité pédagogique renforcée (Oficina de Ciencia y Tecnología del Congreso de los Diputados, 2024 ; Sergent, 2021).

Conclusion

Par conséquent, cette étude met en lumière les tensions propres à l’adoption des IA en classe. Leur usage semble traversé à la fois par une perception positive, soulignant des apports professionnels, et par une perception négative, marquée par la prudence, des incertitudes et le manque de préparation.

Les résultats soulignent également le rôle central des pairs et des réseaux sociaux dans la diffusion des pratiques, ce qui suggère une approche communautaire pour accompagner la formation des enseignants. Par ailleurs, chez les enseignants utilisateurs, l’IA est perçue comme un levier efficace pour la différenciation pédagogique, le suivi des élèves et la continuité pédagogique. Ces constats invitent à concevoir les dispositifs de formation en s’appuyant sur ces dimensions, en les illustrant par des exemples concrets issus du terrain.

Toutefois, notre étude présente certaines limites. Les enseignants du premier degré, majoritairement féminins, ont fourni des données déclaratives recueillies dans un contexte socio-institutionnel spécifique. Il serait donc pertinent de prolonger ce travail en confrontant ces résultats aux usages effectifs observés sur le terrain, tout en envisageant une analyse comparative entre différents niveaux d’enseignement, voire entre systèmes éducatifs internationaux. Par ailleurs, l’essor récent et la popularité croissante des outils d’IA générative depuis la réalisation de cette étude laissent supposer que certains éléments constitutifs des représentations ont déjà évolué. Une étude longitudinale serait ainsi souhaitable afin de suivre l’évolution des perceptions et de l’adoption effective de ces technologies, en intégrant l’impact des nouvelles pratiques ainsi que les changements dans les discours institutionnels et médiatiques.

Références

Abric, J. C. (2001). L’approche structurale des représentations sociales : développements récents. Psychologie et société, 4(2), 81-103. https://fr.scribd.com/document/491402006/Abric-L-approche-structurale-des-representations-sociales-developpements-recents-pdf

Alexandre, L. (2019). IA et éducation. Pouvoirs, 170(3), 105-118. https://doi.org/10.3917/pouv.170.0105

Álvarez-Herrero, J.F. (2024). Opinion of Spanish teachers about artificial intelligence and its use in education. In IoT, AI, and ICT for Educational Applications: Technologies to Enable Education for All (pp. 163-172). Cham: Springer Nature Switzerland. https://doi. org/10.1007/978-3-031-50139-5_8

Amadieu, F. y Tricot, A. (2020). Apprendre avec le numérique. Retz. https://doi.org/10.14375/ NP.9782725638768

Besneville, É., Brillant, C., Caesar, M., Cerisier, J.-F., Devauchelle, B., El Kechaï, H., ... y Landa, M. S. (octubre de 2019). Le numérique éducatif à l’école élémentaire en tension entre politiques nationales, politiques locales et logiques d’appropriation par les enseignants. En Écoles, territoires et numérique: quelles collaborations? Quels apprentissages? Congreso realizado en Clermont-Ferrand, Francia. Recuperado de https://hal.science/hal-02314186/

Bewersdorff, A., Zhai, X., Roberts, J., y Nerdel, C. (2023). Myths, mis- and preconceptions of artificial intelligence: A review of the literature. Computers and Education: Artificial Intelligence, 4, 100143.https://doi.org/ 10.1016/j.caeai.2023. 100143

Collard, A.-S., Hernalesteen, A., Henry, J., Hernalesteen, A. y Jacques, J. (2020, abril). Déconstruire les représentations médiatiques sur l’intelligence artificielle en jouant à « Qui est-ce ? ». Actes TICEMED-12, 4 avril 2020, Athènes, 51-63. https://shs.hal.science/halshs- 03206274/document#page=52

Collin, S. y Marceau, E. (2022). Enjeux éthiques et critiques de l’intelligence artificielle en enseignement supérieur. Éthique publique. Revue internationale d’éthique sociétale et gouvernementale, 24(2). https://doi.org/10.4000/ ethiquepublique.7619

Durkheim, É. (1894). Les Règles de la méthode sociologique. Presse universitaire de France.

Georges, B. (2019). Intelligence artificielle : De quoi parle-t-on ? Constructif, 54(3), 5-10. https:// doi.org/10.3917/const.054.0005

INSEE [Institut National de la Statistique et des Études Économiques]. (2023). Panorama statistique des personnels de l’enseignement scolaire 2023-2024. https://www.insee.fr/fr/statistiques/ 2012662

Jodelet, D. (1991). Les représentations sociales (2e éd.). Presse Universitaire de France.

Kahnbach, L., Hase, A., Kuhl, P. y Lehr, D. (2024). Explaining primary school teachers’ intention to use digital learning platforms for students’ individualized practice: Comparison of the standard UTAUT and an extended model. Frontiers in Education, 9. https://doi. org/10.3389/feduc.2024.1353020

Karsenti, T. (2018). Intelligence artificielle en éducation : L’urgence de préparer les futurs enseignants aujourd’hui pour l’école de demain ? Formation et profession, 26(3), 112-119. https:// doi.org/10.18162/fp.2018.a159

LeCun, Y., Bengio, Y. y Hinton, G. (2015). Deep learning. Nature, 521, 436-444. https://www. nature.com/articles/nature14539

Majkic, Z, y Vranješ, D. (2024). The Integration of Artificial Intelligence across Educational Levels: From Primary School to University. Technics, Informatics, and Education (TIE). https://doi.org/10.46793/TIE24.391M

Maury, Y. y Hedjerassi, N. (2020). Empowerment, pouvoir d’agir en éducation. À la croisée entre théorie(s), discours et pratique(s). Spirale - Revue de recherches en éducation, 66(3), 3-13. https://doi.org/10.3917/spir.066.0003

McCarthy, J., Minsky, M., Rochester, N. y Shannon, C. (1956). Conference on Artificial Intelligence. Dartmouth College. https://doi. org/10.1609/aimag.v27i4.1904

MEN [Ministère de l’Éducation Nationale]. (2021). Grenelle de l’Éducation [synthèse d’atelier] : numérique. https://www.education. gouv.fr/grenelle-de-l-education-synthese- d-atelier-numerique-309065

Moscovici, S. (1986). L’ère des représentations sociales. En W., Doise y A., Palmonari (Dirs.), L´étude des représentations sociales (pp. 4-80). Delachaux et Niestlé.

Oficina de Ciencia y Tecnología del Congreso de los Diputados (2024). Inteligencia artificial y educación: Retos y oportunidades en España (Informe C). Madrid: Oficina de Ciencia y Tecnología del Congreso de los Diputados. https://oficinac.es/es/informes-c/inteligencia- artificial-y-educacion

Pearl, J. (2000). Causality: Models, reasoning and inference. Cambridge University Press.

Polak, S., Schiavo, G. y Zancanaro, M. (2022, abril). Teachers’ perspective on artificial intelligence education: An initial investigation. En S. Barbosa, C., Lampe y C., Appert (Presidencia), CHI EA’22 Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems (pp. 1-7). https://doi. org/10.1145/3491101.3519866

Renaud, J. (2020). Évaluer l’utilisabilité, l’utilité et l’acceptabilité d’un outil didactique au cours du processus de conception continuée dans l’usage. Éducation et didactique, 14(2), 65-84. https://doi. org/10.4000/educationdidactique.6756

Ricoeur, P. (1990). Soi-même comme un autre. Éditions du Seuil.

Romero, M., Heiser, L. y Lepage, A. (2023). Enseigner et apprendre à l’ère de l’intelligence artificielle (Livre blanc). Direction du numérique pour l’éducation, Canopé, GTnum Line #Scol_IA 2020-2022. https://eduq.info/ xmlui/handle/11515/38818

Russell, S. J. y Norvig, P. (2016). Artificial intelligence: A modern approach. Pearson Education.

Sabouret, N. y De Assis, L. (2019). Comprendre l’intelligence artificielle. Editions Ellipses.

Sergent, T. (2021). Étude d’efficience de l’assistant pédagogique Lalilo sur les compétences de décodage en lecture au CP pendant la période de confinement. París: Société Lalilo. https://resources. lalilo.com/Étude+d’efficience+Lalilo.p

UNESCO [United Nations Educational, Scientific and Cultural Organization]. (2019). Consensus de Beijing sur l’intelligence artificielle et l’éducation. París: UNESCO. https://unesdoc.unesco. org/ark:/48223/pf0000368303

Venkatesh, V., Morris, M. G., Davis, M. G. y Davis, F. D. (2003). User acceptance of information technology: Toward a unified view. MIS Quarterly, 27(3), 425-478. https://doi.org/10.2307/30036540

Villani, C. (2018). Donner un sens à l’intelligence artificielle : pour une stratégie nationale et européenne (Informe). París: Gouvernement de la République française. https://www.vie-publique. fr/files/rapport/pdf/184000159.pdf

Zeyringer, M. (2024, junio). L’influence de questions éthiques dans l’usage ou le non-usage, par des professeurs des écoles, d’applications d’ia pour l’enseignement du français et des mathématiques. En M., Murat y S., Manin (Dirs.), Actas de RJC-EIAH 2024, Le Mans Université (pp. 30-39). https://hal.science/hal-04637096/

-